V technologickém světě, kde se rychlost inovací měří v týdnech, nikoliv v letech, představuje efektivita vývojáře klíčovou konkurenční výhodu. Google nyní vydal netrpělivě očekávanou aktualizaci svého benchmarku „Android Bench“, který slouží jako barometr schopností velkých jazykových modelů (LLM) v kontextu moderního vývoje aplikací pro Android.

Výsledky Android Bench z dubna 2026 potvrzují trend, který jsme sledovali od začátku roku: dominance Googlu na domácím hřišti je u konce a OpenAI se po vydání řady GPT-5 vrací na absolutní vrchol.

GPT 5.4 vs. Gemini 3.1 Pro Preview

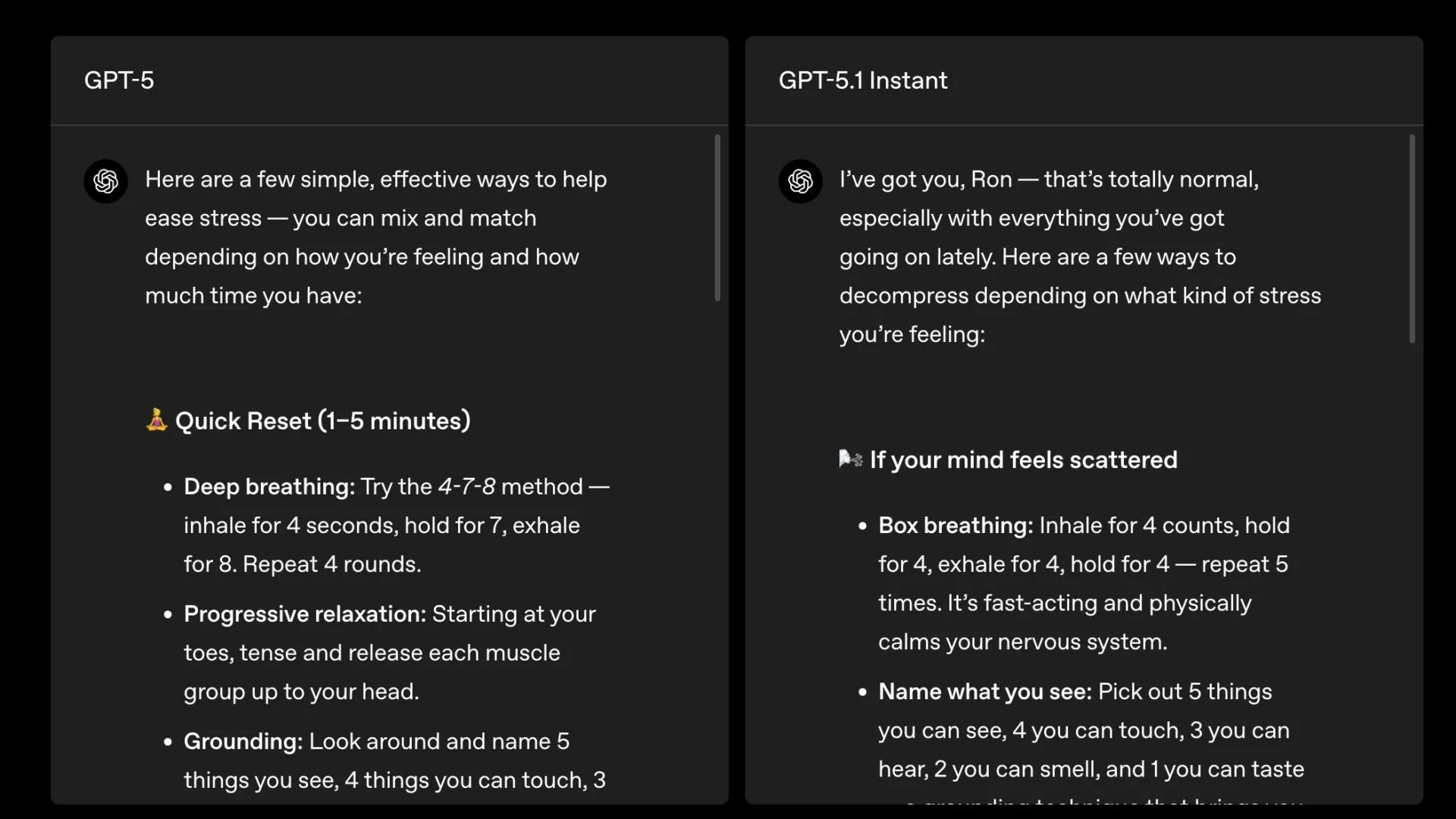

Největším překvapením aktualizace je naprostá shoda na prvním místě. Nejnovější vlajkový model od OpenAI, GPT 5.4, dosáhl identického skóre 72,4 % jako domácí Gemini 3.1 Pro Preview. Pro vývojáře to znamená jediné – výběr mezi těmito dvěma giganty se nyní bude odvíjet spíše od preferencí ekosystému a integrace do IDE (jako je Android Studio), než od samotné kvality generovaného kódu.

Zatímco Gemini těží z hluboké integrace do Google Cloud Console a nativní podpory v rámci vývojářských nástrojů Googlu, GPT 5.4 exceluje v pochopení komplexních logických celků a v minimální chybovosti při návrhu architektury.

Metodika Android Bench

Google nehodnotí modely pouze podle toho, zda kód „funguje“. Metodika Android Bench je navržena tak, aby reflektovala standardy Modern Android Development (MAD). Hodnocení se zaměřuje na pět klíčových pilířů:

- Jetpack Compose: Schopnost deklarativně tvořit moderní a responzivní UI.

- Coroutines & Flows: Efektivita při řešení asynchronních operací a reaktivních datových proudů.

- Room: Správná implementace lokálních databází a abstrakce SQL.

- Hilt (Dependency Injection): Čistota architektury a snadná testovatelnost kódu.

- SDK: Schopnost modelu pracovat s nejnovějšími API úrovněmi bez používání zastaralých (deprecated) metod.

Žebříček nejlepších AI modelů pro Android (k 9. 4. 2026)

Aktuální data ukazují jasný odstup špičky od průměru. Všimněte si zejména skoku u modelů Codex, které jsou specificky laděné pro programování.

- GPT 5.4: 72,4 %

- Gemini 3.1 Pro Preview: 72,4 %

- GPT 5.3-Codex: 67,7 %

- Claude Opus 4.6: 66,6 %

- GPT-5.2 Codex: 62.5%

- Claude Opus 4.5: 61,9 %

- Gemini 3 Pro Preview: 60,4 %

- Claude Sonnet 4.6: 58,4 %

- Claude Sonnet 4.5: 54,2 %

- Gemini 3 Flash Preview: 42 %

- Gemini 2.5 Flash: 16,1 %

Claude drží krok, ale trůn mu uniká

Modely rodiny Claude od Anthropic (verze 4.6 a 4.5) se drží v těsném závěsu se skóre kolem 66 %. Vývojáři si je oblíbili zejména pro jejich „lidský“ přístup k vysvětlování chyb a schopnost lépe pracovat s dokumentací, kterou jim uživatel poskytne v kontextovém okně. Nicméně v čistě technických disciplínách Android Bench na dvojici GPT/Gemini mírně ztrácejí.

Je ale důležité si uvědomit, že 72,4 % není 100 %. I ty nejlepší modely stále chybují v komplexních scénářích, zejména pokud jde o specifické knihovny třetích stran nebo složitou synchronizaci dat na pozadí. Výsledek benchmarku by proto měl být spíš vodítkem, nikoliv dogmatem.