Google představil Agentic Vision – novou schopnost modelu Gemini 3 Flash, která výrazně zlepšuje přesnost při práci s obrázky. Místo pasivního pohledu na obrázek teď model aktivně zkoumá vizuální data, používá k tomu Python kód, zoom, ořez a dokonce kreslí poznámky přímo do obrázku.

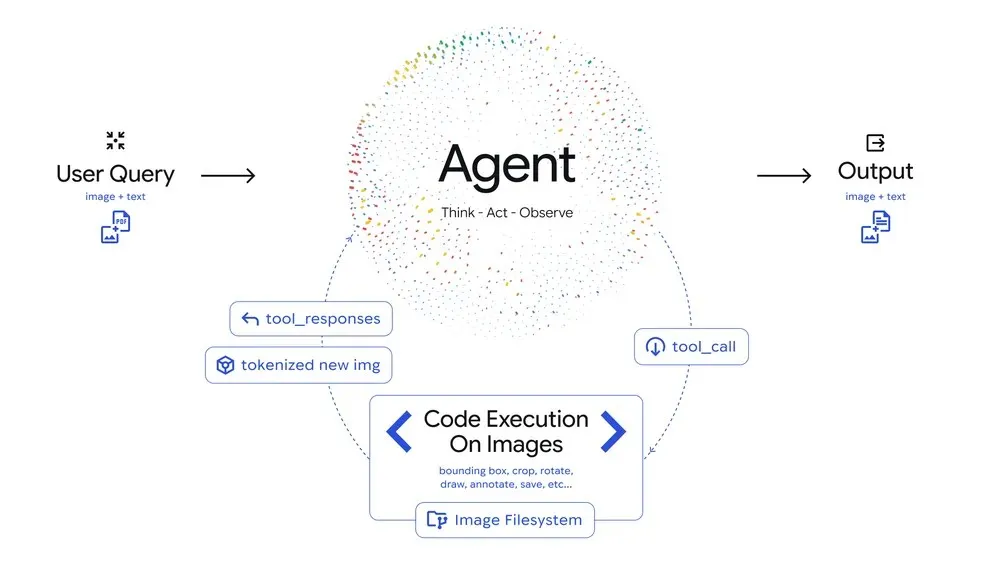

Metoda Agentic Vision, jíž nyní Google zavedl, využívá tzv. Think – Act – Observe cyklus:

- Think (Mysli): Model analyzuje dotaz a obrázek, vytvoří plán kroků

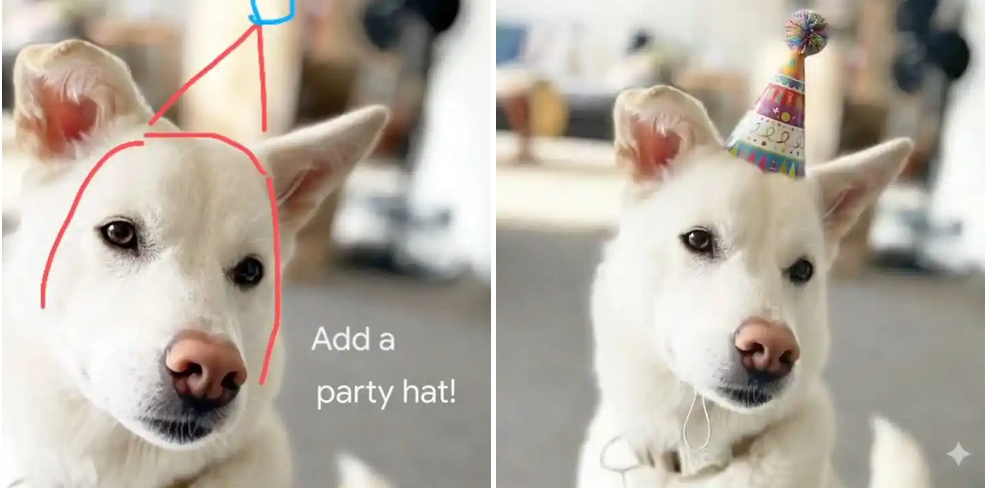

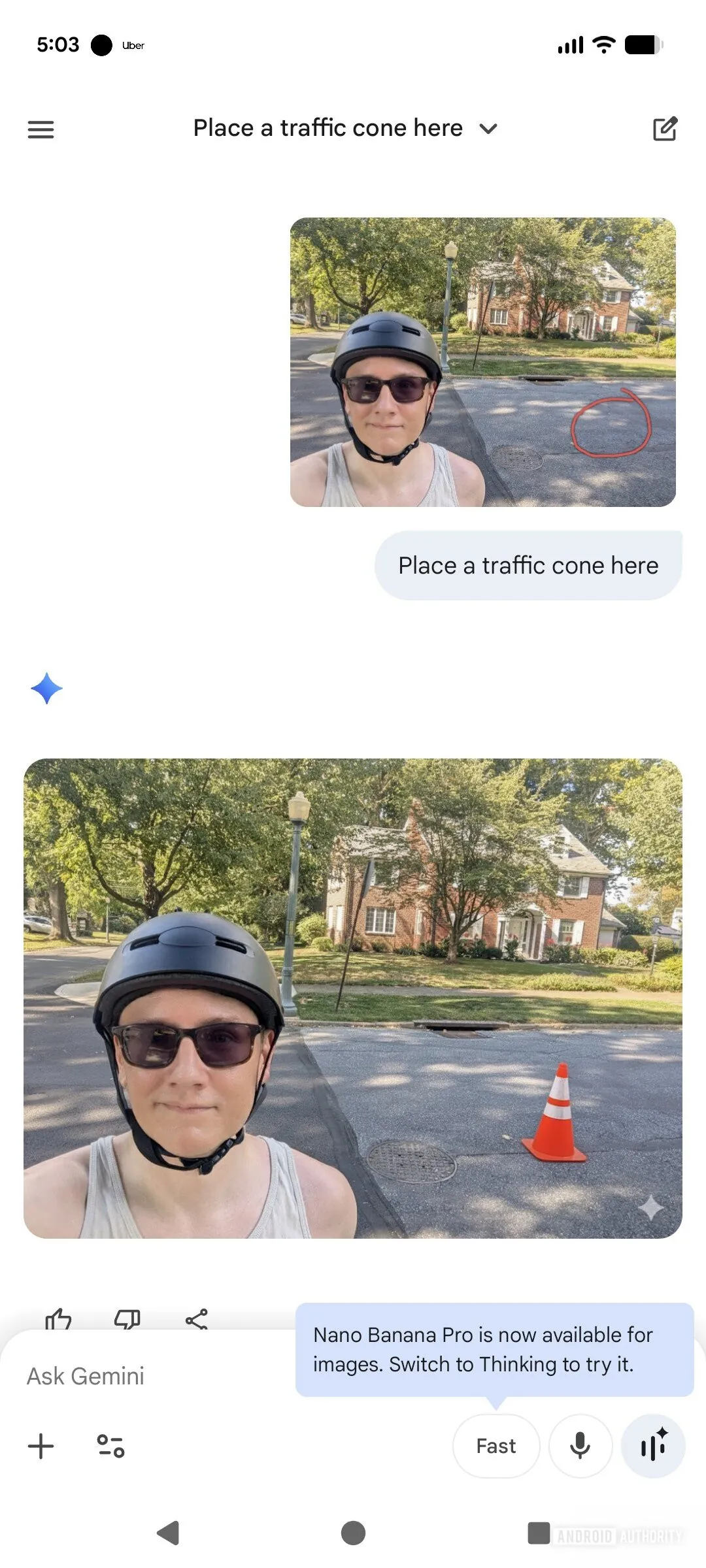

- Act (Jednej): Vygeneruje a spustí kód, kterým obrázek upraví – např. ořízne, přiblíží, spočítá objekty nebo provede vizuální výpočty

- Observe (Pozoruj): Výsledný obrázek vloží zpět do kontextu a na základě něj vytvoří odpověď

Když například Gemini požádáte, aby spočítala prsty na ruce, použije Python k vykreslení očíslovaných rámečků kolem každého prstu. Tím se vyhne klasickým chybám LLM modelů při vizuálních úlohách. Stejně tak zvládne analyzovat složité tabulky nebo vizualizovat matematické výpočty s ověřitelnými výsledky.

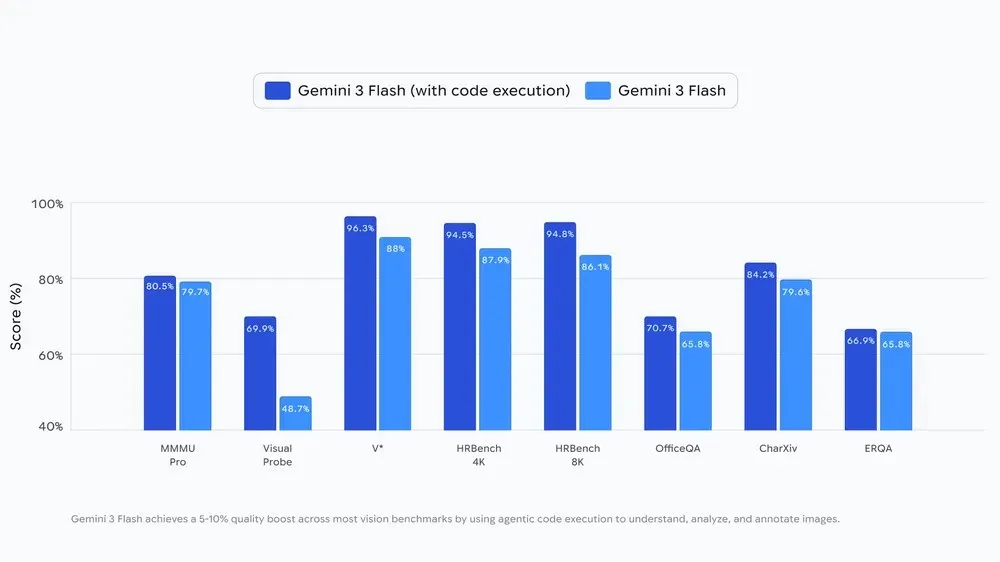

Agentic Vision přináší podle Googlu 5–10% zlepšení přesnosti ve vizuálních benchmark testech. Funkce se začíná objevovat v aplikaci Gemini a už je dostupná pro vývojáře v Google AI Studio i Vertex AI.

V budoucnu se očekává, že model bude ještě lépe rozpoznávat vizuální detaily bez explicitního zadání, například sám od sebe přiblíží detail nebo otočí obrázek. Přibýt má i možnost reverzního vyhledávání a práce s webovým obsahem, což dá modelu širší kontext pro odpovědi založené na reálném světě.