Příslib špičkového uvažování modelu Gemini a jeho integrace do ekosystému Google Workspace je lákavý. Ale aby vše fungovalo perfektně a z Gemini se stala reálná virtuální asistentka, je třeba platit. A totéž se týká ChatGPT a jeho nejpokročilejších modelů. Což mi není moc po chuti. S příchodem nové generace otevřených modelů jako Gemma 4 nebo Qwen 3.6 se naštěstí možnosti rozšířili a výběr je mnohem pestřejší i bez předplatného.

Po experimentování s Gemini jsem se rozhodla zrušit cloudový tarif od Googlu a přenesla svou práci a doslova virtuální život na lokální infrastrukturu běžící na vlastním hardwaru. Po několika týdnech mohu konstatovat, že soukromí mám opět pod kontrolou, rychlost odezvy se výrazně snížila a moje produktivita neutrpěla jedinou trhlinu. Existuje přitom více možností, které můžete využít.

Gemma 4

Model Gemma 4, open-weight sourozenec Gemini, prakticky smazal výkonnostní rozdíly v mém každodenním workflow. Její síla netkví v univerzalitě, ale ve specializaci. Ve svém nastavení využívám dvě specifické možnosti, které pokrývají celé spektrum mých potřeb.

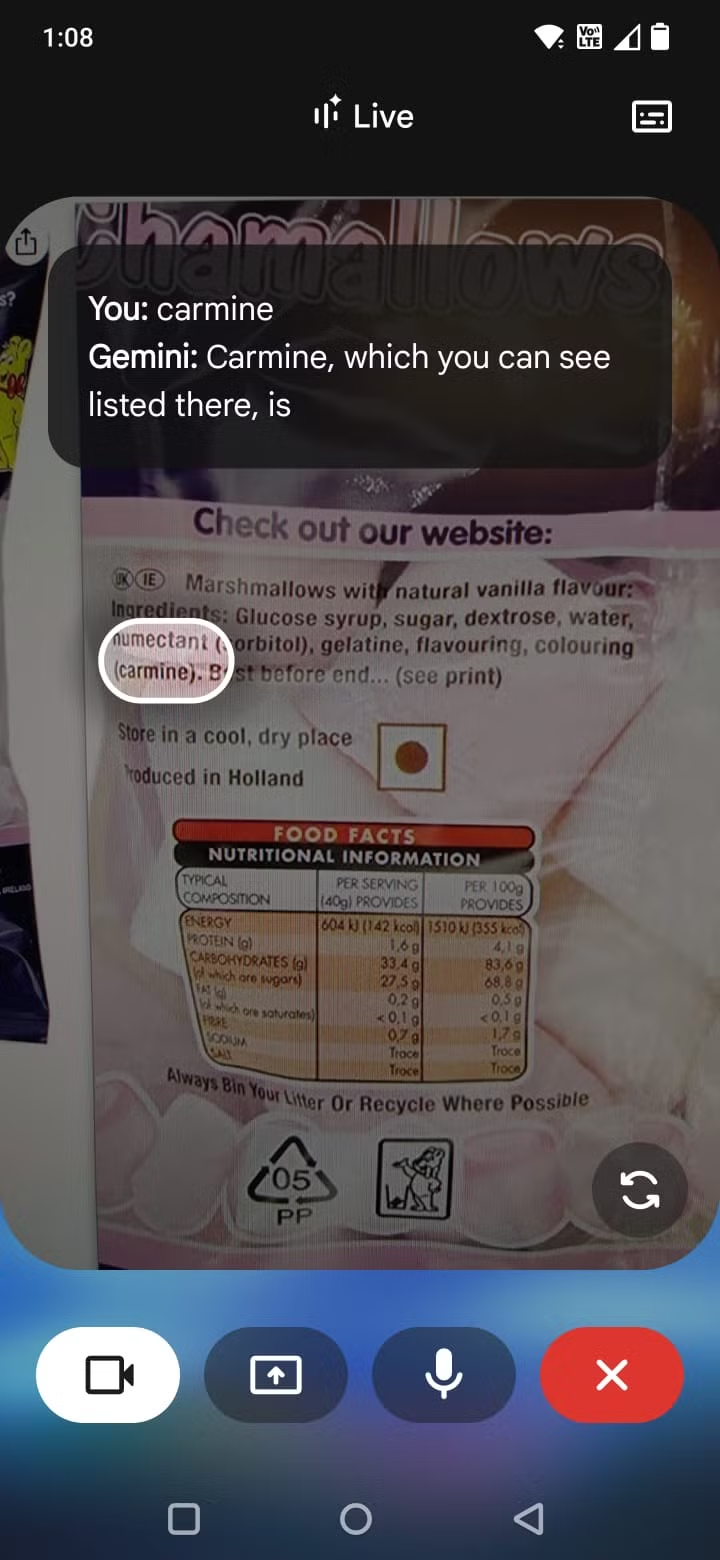

Pro mobilní využití mám model Gemma 4 E2B. Jde o mistrovské dílo mobilního inženýrství, které na Androidu funguje plně offline skrze Google AI Edge Gallery. Díky minimálním nárokům na hardware (stačí přibližně 1,5 GB RAM) zvládá bleskově generovat profesionální korespondenci nebo sumarizovat rozsáhlá PDF i v místech bez signálu.

V momentě, kdy zasednu k počítači s Windows, přebírá otěže Gemma 4 26B-A4B. Ačkoliv disponuje 26 miliardami parametrů, díky efektivní architektuře využívá pro výpočet jednoho tokenu pouze 3,8 miliardy. To mi umožňuje provádět hloubkovou analýzu technických dat v reálném čase.

Qwen 3.6-27B

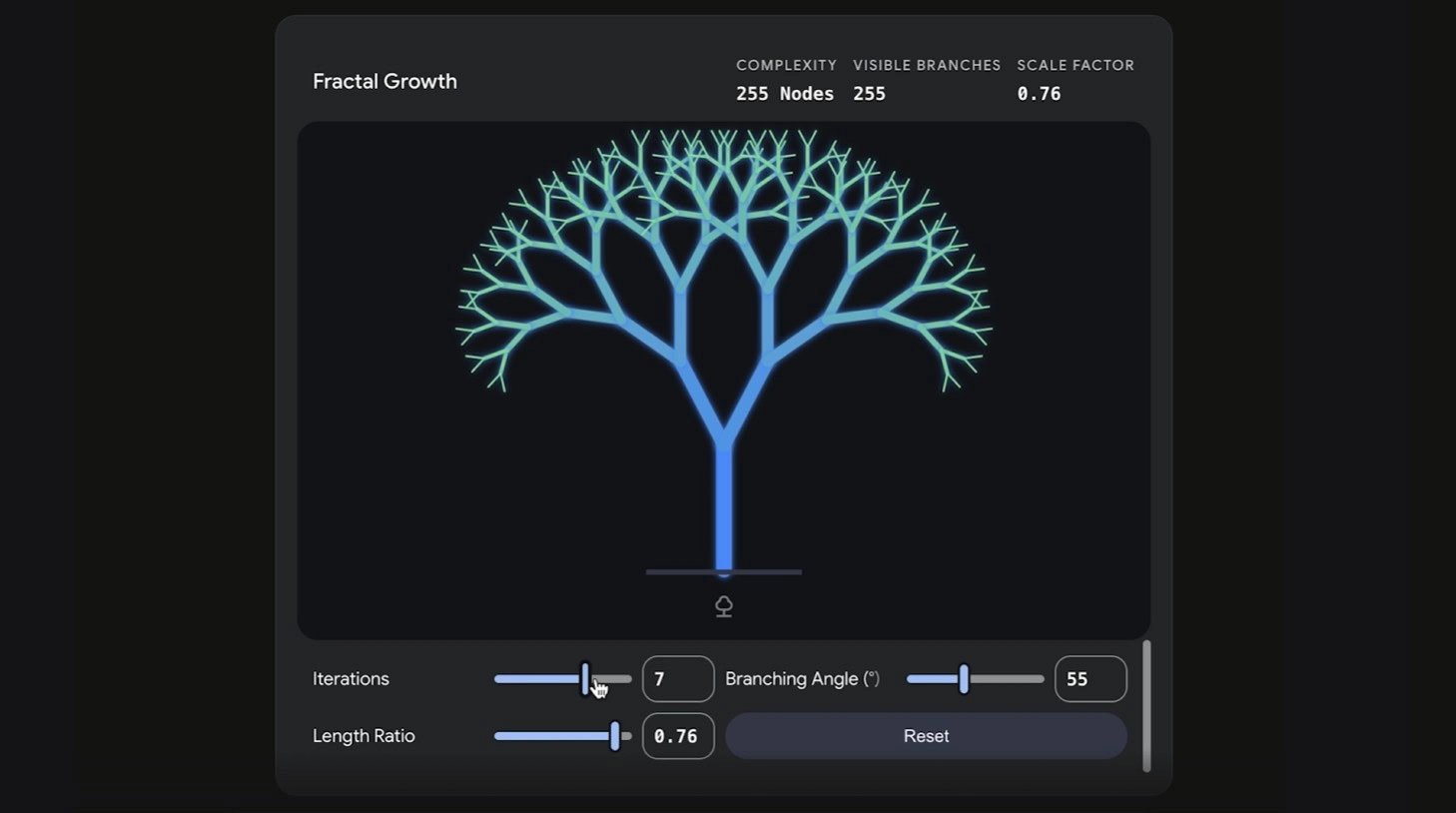

Zatímco Gemma obstarává běžnou agendu, Qwen 3.6-27B zastává roli seniorního vývojáře. Pro programátory, kteří chtějí eliminovat závislost na cloudu, jde o přelomový nástroj. Jeho hlavní výhodou je agentní plynulost. Model nepracuje jen na úrovni řádků kódu, ale chápe kontext celého repozitáře.

Díky nasazení přes LM Studio s využitím GPU akcelerace dosahuje téměř okamžité odezvy. Exceluje v benchmarku Terminal-Bench, což z něj dělá ideálního společníka pro automatizaci úloh.

Ministral 3 3B

Pokud hledáte rychlost, která cloudové modely odsouvá do pozadí, je tu Ministral 3 3B. Tento kompaktní model je důkazem, že na velikosti parametrů nezáleží tolik jako na efektivitě tréninku. Mám ho připnutý na hlavním panelu pro stovky drobných úkolů, které by jinak zbytečně konzumovaly čas i tokeny velkých modelů.

Ministral si i přes svou subtilnost zachovává překvapivou kontextovou souvislost i v delších konverzacích. Jeho odpovědi působí věcně a technicky, bez zbytečného „mentoringu“, který je typický pro velké komerční modely jako ChatGPT.

Přechod z předplatného Google AI tak nutně nemusí být ústupkem, ale spíš upgradem. Získáte systém, který je rychlejší, bezpečnější a plně pod vaší kontrolou. Lokální LLM už nejsou hračkou pro nadšence, ale profesionálními nástroji pro komplexní vývoj a výzkum. Stačí jen zvolit správný model.