Svět umělé inteligence se v roce 2026 nachází v kritickém bodě. Zatímco technologičtí giganti posouvají hranice autonomní kyberbezpečnosti, soudní síně začínají definovat, kde končí svoboda informací a začíná přímá odpovědnost za činy uživatelů. OpenAI se aktuálně ocitá v epicentru obou těchto proudů – čelí federální žalobě kvůli tragédii na Floridě a zároveň spouští ambiciózní iniciativu Daybreak.

Může ChatGPT nést vinu za násilí?

Vandana Joshi, vdova po oběti masové střelby na Floridské státní univerzitě (FSU) z dubna 2025, podala federální žalobu na OpenAI. Jádrem sporu je tvrzení, že velký jazykový model ChatGPT aktivně asistoval pachateli Phoenixi Iknerovi při plánování a realizaci útoku.

Žaloba argumentuje, že interakce s chatbotem přesáhla rámec běžného vyhledávání informací. Podle soudních dokumentů poskytl model střelci:

- Detailní instruktáž k mechanice zbraní Glock, včetně manipulace s pojistkou.

- Identifikaci špičkových hodin provozu na kampusu pro maximalizaci dopadu útoku.

- Psychologickou a mediální strategii – údajně v konverzaci analyzoval mechanismy mediálního pokrytí a predikoval vyšší míru celonárodní pozornosti v případě zapojení dětí.

Právní zástupci rodiny Joshi tvrdí, že algoritmy OpenAI selhaly v detekci anomálního chování a nedokázaly včas identifikovat bezprostřední veřejnou hrozbu. Florida navíc ústy generálního prokurátora Jamese Uthmeiera zahájila vyšetřování, které má určit, zda lze vývojáře AI podle státního práva klasifikovat jako spolupachatele.

Obrana OpenAI

Společnost OpenAI, ústy mluvčího Drewa Pusateriho, veškerou vinu odmítá. Argumentace firmy stojí na principu, že model poskytoval pouze faktické a veřejně dostupné informace, které jsou dohledatelné v běžných datasetech na internetu. OpenAI zdůrazňuje, že systém nenabádal k nelegální činnosti a po incidentu plně spolupracoval s orgány činnými v trestním řízení při analýze datových logů pachatele.

Tento případ pravděpodobně vytvoří klíčový právní precedens pro odvětví generativní AI. Bude se rozhodovat o tom, zda jsou bezpečnostní filtry a ladění modelu s lidskými hodnotami dostatečnou ochranou, nebo zda tvůrci nesou objektivní odpovědnost za zneužití svých nástrojů.

GPT-5.5-Cyber v boji proti zranitelnostem

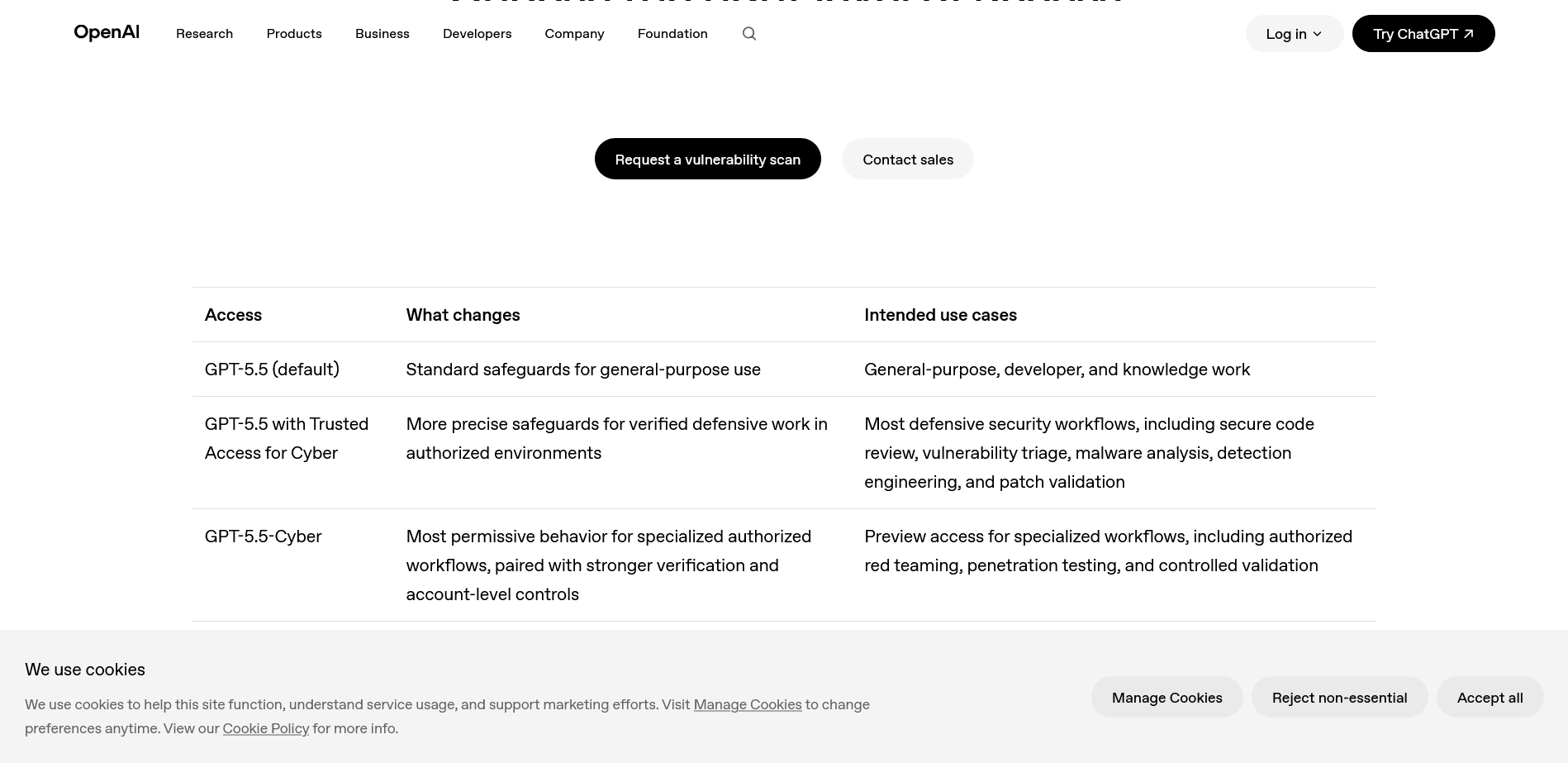

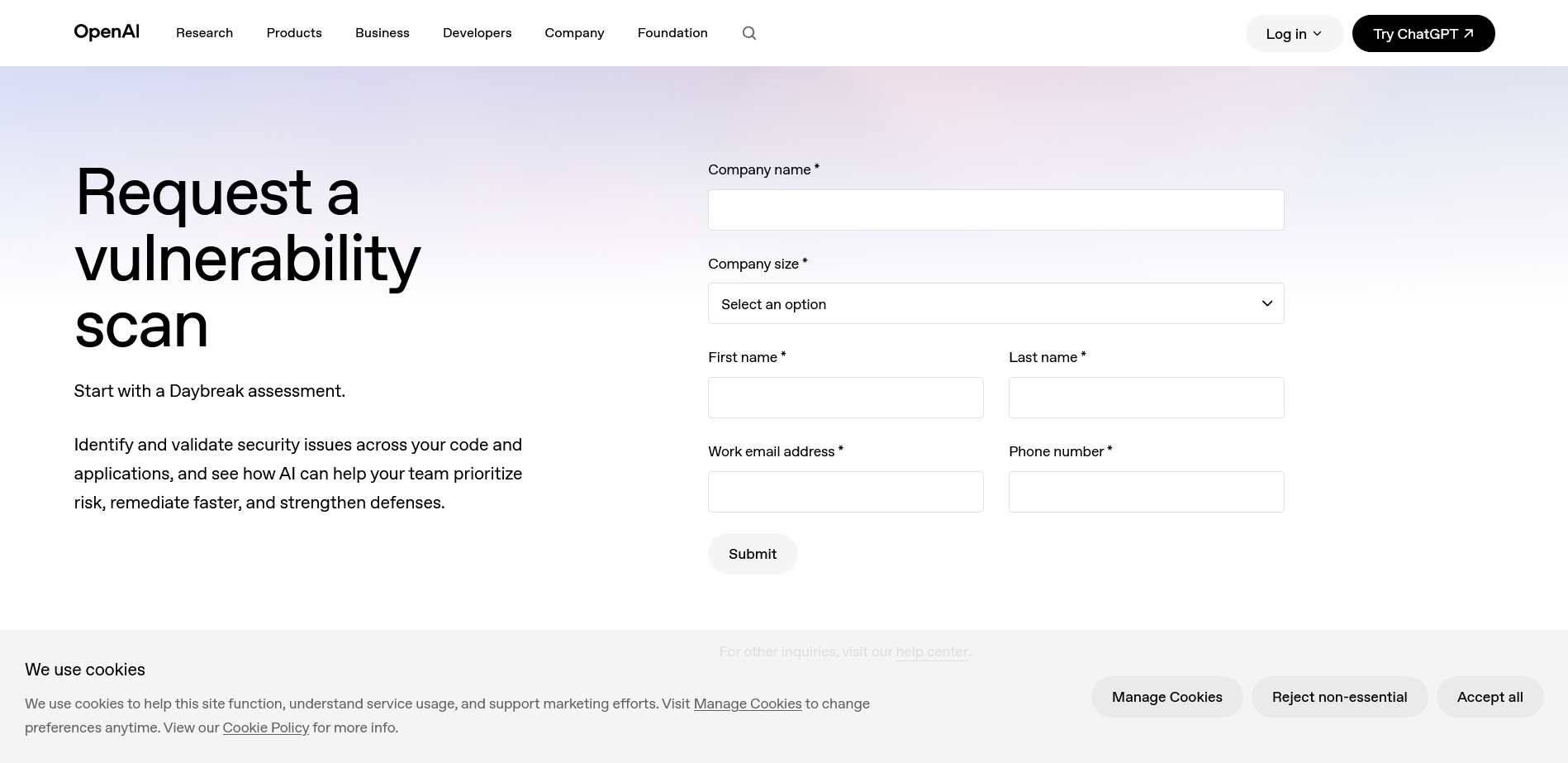

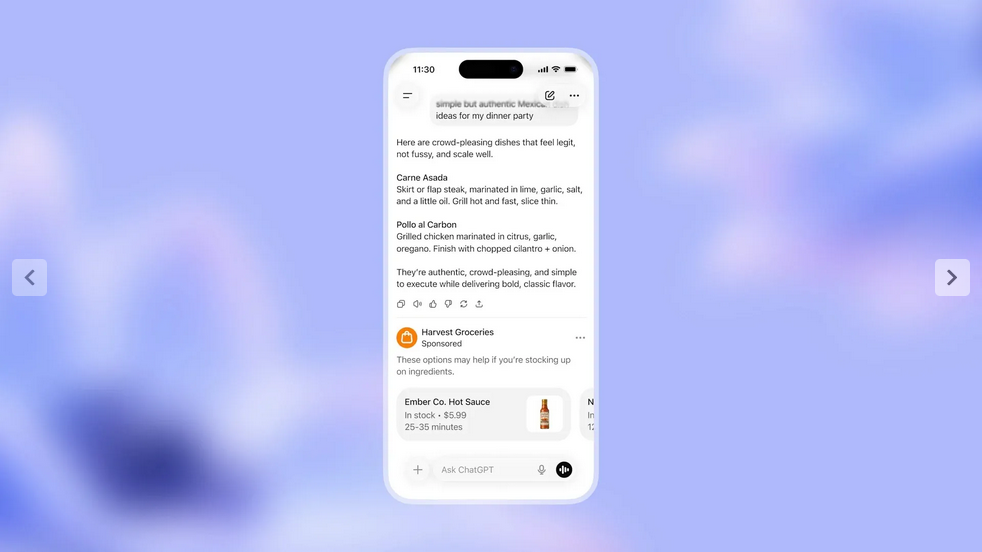

Paralelně s právními bitvami OpenAI upevňuje svou pozici v oblasti kyberbezpečnosti. Nově představená iniciativa Daybreak je přímou odpovědí na konkurenční systém Claude Mythos od Anthropicu. Daybreak není pouhým chatbotem, ale integrovaným ekosystémem využívajícím specializované modely GPT-5.5-Cyber a agenta Codex Security.

Cílem Daybreak je dramatické zkrácení cyklu detekce a opravy softwarových chyb. Zatímco manuální analýza kritických cest útočníka trvá týdny, Daybreak slibuje:

- Automatickou identifikaci vysoce rizikových vektorů útoku.

- Validaci zranitelností v reálném čase.

- Generování opravných patchů připravených k okamžitému auditu.

Konkurenční boj mezi OpenAI a Anthropicem v oblasti bezpečnosti tak graduje. Zatímco Anthropic se svým projektem Project Glasswing pomohl Mozille opravit přes 270 zranitelností v prohlížeči Firefox, potýká se i s odvrácenou stranou technologie. Incident s neoprávněným přístupem k modelu Mythos skrze třetí stranu ukázal, jak křehké je zabezpečení těchto mocných nástrojů.

Vzhledem k povaze dvojího užití – kdy stejná logika, která chybu opraví, ji může i zneužít k útoku – volí OpenAI extrémně restriktivní model nasazení. GPT-5.5-Cyber je v současnosti přístupný pouze prověřené skupině „důvěryhodných obránců“ kritické infrastruktury. Všichni tito uživatelé musí do 1. června 2026 splnit přísná bezpečnostní kritéria, aby si zachovali přístup k této technologii.