La promesse d'une pensée de pointe du modèle Gemini et son intégration à l'écosystème Google Workspace est tentante. Mais pour que tout fonctionne parfaitement depuis Google Workspace, il faut…mini est devenu un véritable assistant virtuel, il faut payer. Et il en va de même pour ChatGPT et ses modèles les plus avancés. Que je n'apprécie guère. Heureusement, avec l'arrivée d'une nouvelle génération de modèles ouverts comme la Gemma 4 ou la Qwen 3.6, les options se sont multipliées et le choix est bien plus diversifié, même sans abonnement.

Après avoir expérimenté avec Gemini J'ai décidé d'annuler. cloudnouveau tarif de Google et a transféré son travail, et littéralement sa vie virtuelle, sur une infrastructure locale fonctionnant sur son propre matériel. Après quelques semaines, je peux dire que J'ai de nouveau le contrôle de ma vie privée.La vitesse de réponse a considérablement diminué, mais ma productivité n'en a pas souffert. Il existe cependant d'autres options à votre disposition.

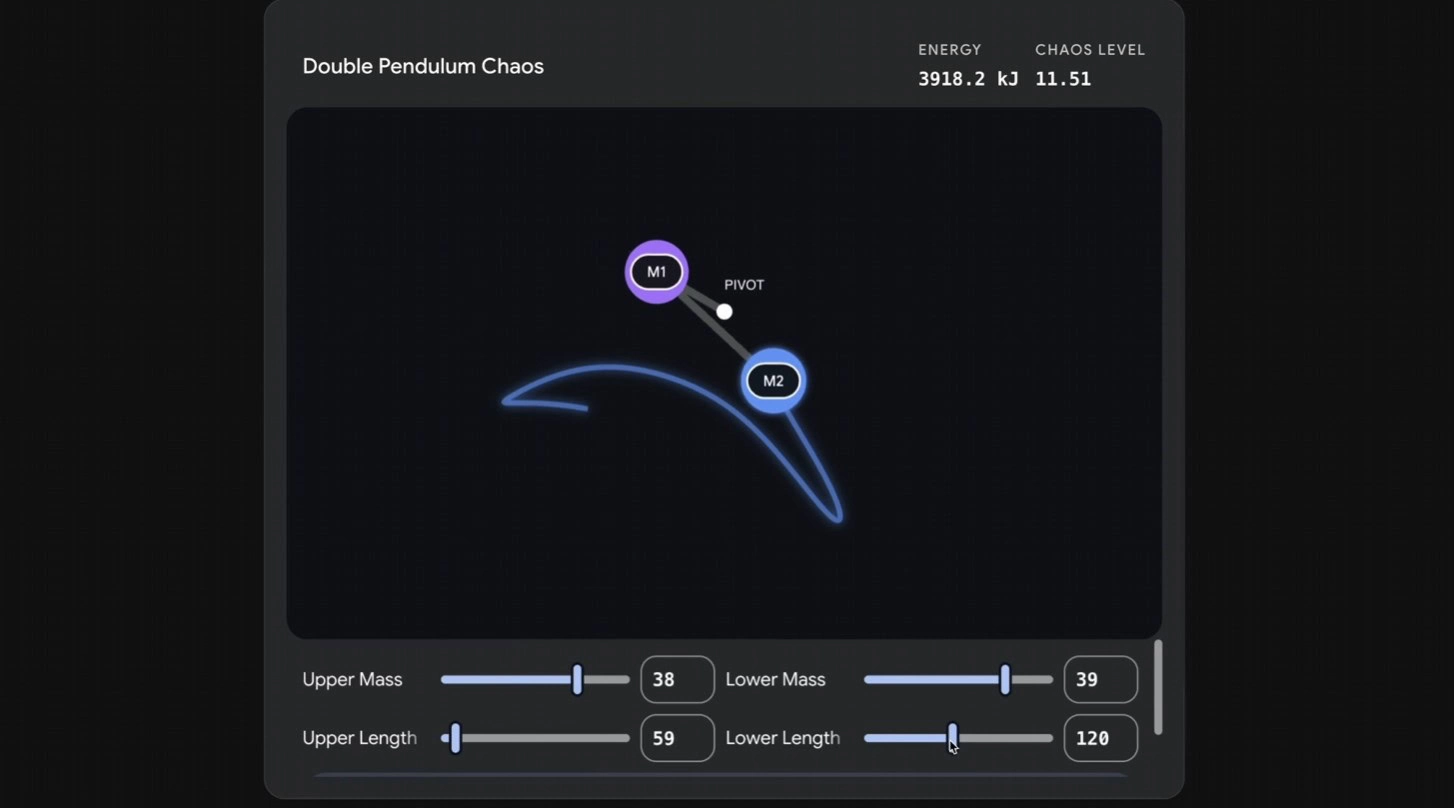

Gem 4

Modèle Gem 4, frère ou sœur de Ge, en catégorie poids libremini, a pratiquement comblé le manque de performance dans mon flux de travail quotidien. Sa force ne réside pas dans son universalité, mais dans spécialisationDans ma configuration, j'utilise deux options spécifiques qui couvrent l'ensemble de mes besoins.

J'ai un modèle pour l'utilisation mobile Gemma 4 E2BC'est un chef-d'œuvre d'ingénierie mobile qui fonctionne entièrement sous Android. direct à travers Galerie Google AI EdgeMerci miniAvec des exigences matérielles minimales (environ 1,5 Go de RAM suffisent), il peut générer rapidement une correspondance professionnelle ou résumer de gros fichiers PDF, même dans des endroits sans réseau.

Dès que je m'assieds à l'ordinateur avec Windows, prend les rênes Gemma 4 26B-A4BBien qu'il comporte 26 milliards de paramètres, son architecture performante lui permet d'en utiliser seulement 3,8 milliards pour calculer un seul jeton. Cela me permet d'effectuer une analyse approfondie des données techniques en temps réel.

Qwen 3.6-27B

Pendant que Gemma s'occupe des tâches habituelles, Qwen 3.6-27B occupe le poste de développeur senior. programmeursqui veulent éliminer la dépendance à cloudu, c'est un outil révolutionnaire. Son principal avantage réside dans la fluidité des agents. Le modèle ne fonctionne pas seulement au niveau des lignes de code, mais comprend le contexte l'intégralité du dépôt.

Grâce au déploiement sur Studio LM Grâce à l'accélération GPU, il offre une réponse quasi instantanée. ExcelIl figure dans le benchmark Terminal-Bench, ce qui en fait un outil idéal pour l'automatisation des tâches.

Ministral 3 3B

Si vous recherchez la vitesse, cloudrelègue les anciens modèles au second plan, il y a Ministral 3 3BCe modèle compact prouve que la taille importe moins que l'efficacité de l'entraînement. Je l'ai épinglé à mon tableau de bord depuis des centaines de minutes. petites tâches, ce qui autrement consommerait inutilement du temps et des ressources pour les grands modèles.

Malgré sa subtilité, le ministroller conserve une cohérence contextuelle surprenante, même dans les conversations plus longues. Ses réponses sont impressionnantes. pour toujours et techniquement, sans le « mentorat » inutile qui caractérise les grands modèles commerciaux comme ChatGPT.

Passer d'un abonnement Google AI à une autre plateforme n'est donc pas forcément un compromis, mais plutôt une mise à niveau. Vous obtiendrez un système qui est plus rapide, plus sûr et entièrement sous votre contrôle. Les LLM locaux ne sont plus un simple jouet pour passionnés, mais des outils professionnels pour un développement et une recherche approfondis. Il vous suffit de choisir le modèle adapté.